AIと脳科学の関係

生成AI(ChatGPTなど)を使っていて、「なぜこんなに自信満々で間違えるんだろう?」と感じたことはありませんか?

実は、AIの“おかしな振る舞い”には、人間の脳と似たような特徴が隠れているのです。

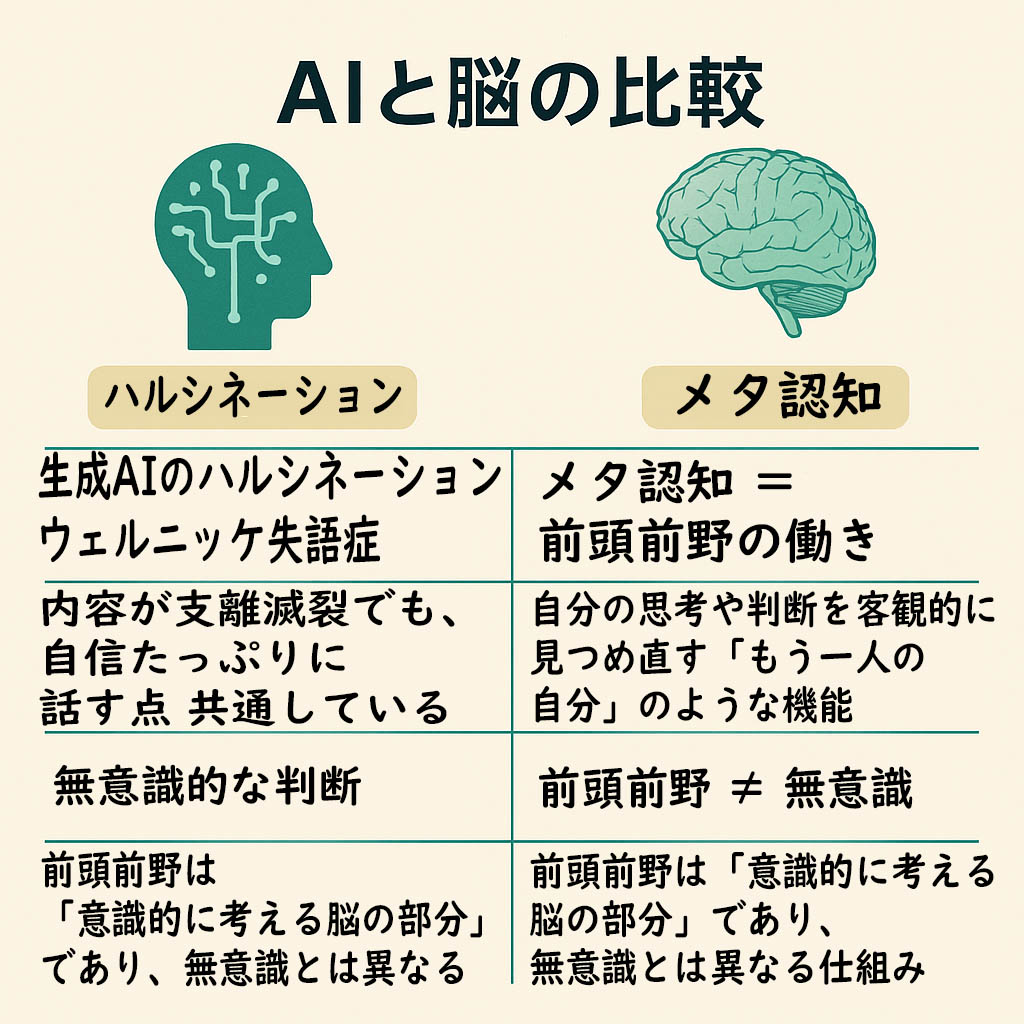

ここでは、「ハルシネーション」「メタ認知」「無意識的判断」の3つのテーマを軸に、AIと脳科学の関係を比較してみましょう。

✅ 比較表:AIと脳科学の意外なつながり

| 現象・機能 | AI・脳科学での例え | 説明 |

|---|---|---|

| ハルシネーション | 生成AIのハルシネーション ≈ ウェルニッケ失語 | 内容が支離滅裂でも、自信たっぷりに話す点が共通している |

| メタ認知 | メタ認知 ≈ 前頭前野の働き | 自分の思考や判断を客観的に見つめ直す「もう一人の自分」のような機能 |

| 無意識的な判断 | 前頭前野 ≠ 無意識 | 前頭前野は「意識的に考える脳の部分」であり、無意識とは異なる仕組み |

🌀 ハルシネーション ≈ ウェルニッケ失語

生成AIが、間違っているのにもっともらしく話す現象を「ハルシネーション」と呼びます。これは、脳のウェルニッケ失語と似ています。

ウェルニッケ失語の人は、言葉はスラスラ出ますが、内容がめちゃくちゃになることがあります。それでも本人は**「正しいことを話している」と感じてしまう**のです。

AIもまさに同じで、間違った情報を**“自信満々”に出してしまう**のです。これが、AIに「良心」や「判断力」がないといわれる原因のひとつです。

🧠 メタ認知 ≈ 前頭前野の働き

メタ認知とは、「自分の思考や行動を、外から見る力」のこと。

たとえば、「この答え、本当に正しいかな?」「他にもっと良い方法は?」と考えるとき、**前頭前野(脳の前の部分)**が活躍しています。

あなたがChatGPTやGemini、DeepSeekなどのAIを使って自分の言葉を見直しているとしたら、それはまさにメタ認知を使っている証拠です。

でも、AIにはこの力がまだありません。だから、間違っていることに気づかず、平気で話し続けるのです。

🌙 無意識的判断 ≠ 前頭前野

人間の脳は、無意識に多くの選択をしています。

「駅までの道を自然と選ぶ」「朝ごはんを何となく決める」──これらはすべて、無意識的な判断によるものです。

一方で、前頭前野は“意識的に考える”場所。

たとえば、「この記事を書くにはどうするか?」など、目的を持って考えるときに働きます。

つまり、「無意識」と「前頭前野」はまったく同じではありません。

この違いを理解することは、AIの“思考の仕組み”と人間の“意識の仕組み”を見比べるうえでとても重要です。

🔧 特許の可能性:AIに“メタ認知”を与える技術とは?

今回紹介したように、生成AIの限界は「自分の間違いに気づけないこと」にあります。

そこで注目されているのが、「AIにメタ認知機能を持たせる技術」です。

💡 発明アイデアの概要

発明名(案):メタ認知レベルを外部から評価・補正するAI対話システム

【技術的課題】

現在のAIは、自身の回答の正確性や信頼度をユーザーに分かりやすく提示する仕組みが不足しています。これにより、“ハルシネーション”を見抜けずに誤解や誤用が生じるリスクがあります。

【発明の構成】

- 複数のAI(例:ChatGPT・Gemini・DeepSeek)での回答比較モジュール

- ユーザーの判断履歴・フィードバックを取り込む学習回路

- 信頼スコア(Confidence Level)を“視覚化”するUI設計

- 回答の確信度と事実性に“差”がある場合の警告表示システム

【効果】

- ユーザーは**「自分で確認する」メタ認知的な行動**を自然に促される

- AIの出力が「どれくらい正確で、どれくらい信頼できるか」が明示される

- 教育・医療・ビジネスなど、「間違いが致命的になる分野」での安全性が向上する

🧠 この技術が活かせる分野

- 教育用AI教材(中高生・受験生向け)

- 医療AIの診断補助システム

- 知財・法務AIによる契約書チェック

- 認知リハビリ(失語症・高次脳機能障害など)支援アプリ

📝 まとめ

AIと脳の比較を通じて、「AIの限界」だけでなく、「人間らしい思考とは何か」を見直すきっかけが見えてきました。そして、こうした比較が次の発明の種になることもあるのです。

私たちの未来は、AIと人間が互いに補い合う時代。

そのための「安心・安全・信頼できるAI設計」に向けて、特許や技術の工夫がますます重要になっていくでしょう。

コメント